Su Poetessedonne.it, progetto editoriale dedicato alle poetesse del passato e del presente, per 5 anni ho raccolto le interviste delle poetesse contemporanee. Ogni nuova intervista arricchiva l’archivio delle voci femminili e ampliava il mio “atlante delle poetesse”.

A un certo punto ho iniziato a guardare quel patrimonio con una domanda diversa, specialmente mentre riflettevo sul fatto che non esistono report sulla poesia femminile contemporanea e AI Mode mi faceva notare che, per alcune keyword, ero meno rilevante di una Accademia della Crusca o di Garzanti.

E se questi contenuti non fossero soltanto contenuti?

E se fossero già dati?

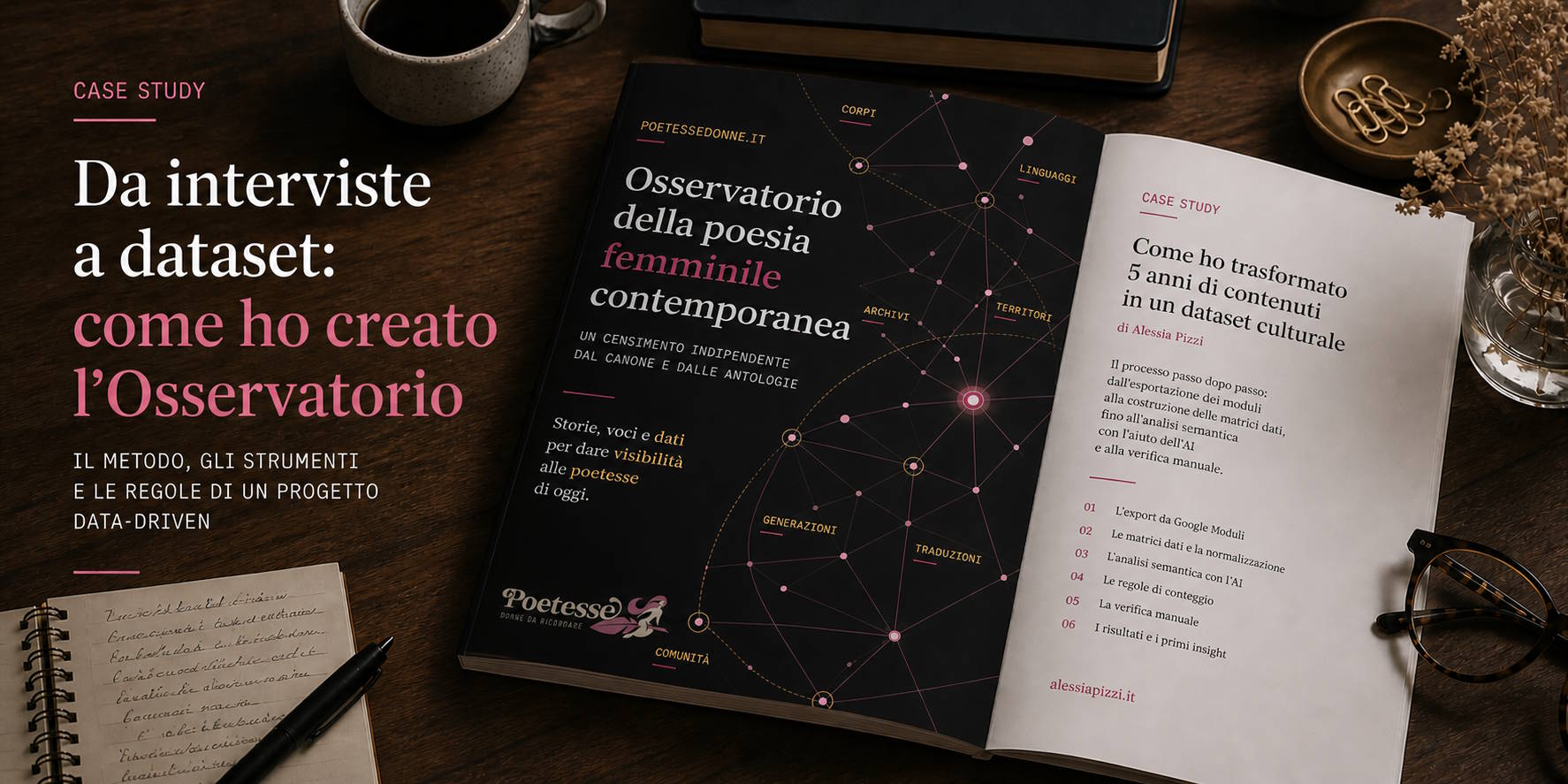

Da questa domanda nasce l’Osservatorio della poesia femminile contemporanea di Poetessedonne.it, con l’obiettivo di avere un report indipendente dai canoni, dalle antologie e dai libri di scuola, dove spesso le poetesse non sono rappresentate.

Ma il dato più interessante, in questa sede, non riguarda la poesia. Riguarda il metodo.

Il punto di partenza: Google Moduli

Dal 2021, la sezione Autoritratti di Poetessedonne.it raccoglie le risposte delle poetesse attraverso un’intervista strutturata realizzata con Google Moduli.

Ogni intervista contiene informazioni sia quantitative sia qualitative:

- età (quando dichiarata)

- provenienza geografica

- libri pubblicati

- case editrici

- modelli poetici di riferimento

- temi ricorrenti nella scrittura

- esperienze editoriali e professionali

Dopo cinque anni, il primo passo è stato molto semplice:

esportare tutte le risposte in Excel.

Un’operazione apparentemente banale, ma che ha trasformato un archivio editoriale in una base dati.

Dall’Excel grezzo alle matrici dati

L’export di Google Moduli, naturalmente, non era ancora un dataset.

Le risposte erano:

- eterogenee

- narrative

- incomplete in alcuni campi

- scritte con formati diversi

Per questo ho costruito manualmente una serie di matrici dati, normalizzando le informazioni più strutturate.

Per esempio:

Geografia

“Roma” → Lazio

“Napoli” → Campania

“Bologna” → Emilia-Romagna

Produzione editoriale

Numero di sillogi pubblicate per poetessa.

Case editrici

Uniformazione di varianti come:

- Ensemble

- Ensemble Edizioni

oppure:

- Progetto Cultura

- Edizioni Progetto Cultura

Questo è il passaggio meno visibile ed è anche quello più importante. Perché un dataset è credibile se accurato e pulito.

Dove entra l’AI

La parte più complessa riguardava i campi aperti. In particolare due:

Modelli poetici

Domande come:

“Chi sono i tuoi modelli poetici?”

Temi poetici

Domande come:

“A cosa si ispira la tua poesia?”

Qui il semplice Excel non bastava più. Con l’aiuto dell’AI ho costruito piccoli script Python rule-based per identificare e contare le occorrenze semantiche.

In pratica lo script leggeva le risposte, riconosceva parole chiave, varianti, cognomi, sinonimi e ricondurli a categorie comuni.

Per esempio:

Modelli poetici

“Merini”

“Alda”

“Alda Merini”

→ Alda Merini

Temi

“vissuto”

“esperienza personale”

“vita quotidiana”

→ Esperienza di vita

Un dettaglio metodologico fondamentale

Il conteggio non è stato fatto sulle parole, è stato fatto sulle persone.

Questo significa che se una poetessa cita “Alda Merini” tre volte nella stessa risposta viene comunque conteggiata una sola volta.

Lo stesso vale per i temi. L’obiettivo non era misurare la frequenza lessicale, ma misurare la diffusione culturale di un riferimento all’interno del campione.

È una differenza metodologica piccola, ma cambia completamente il valore del dato.

L’AI accelera, ma la validazione resta umana

In questo progetto l’intelligenza artificiale è stata preziosa, soprattutto nella fase di classificazione semantica e nella costruzione degli script di analisi.

Ma l’AI, da sola, non avrebbe potuto costruire un dataset credibile. Prima dell’automazione è stato necessario definire:

- una matrice dati coerente

- categorie interpretative condivise

- regole esplicite di conteggio

- prompt e istruzioni per rendere l’analisi replicabile

Dopo l’elaborazione automatica, i risultati sono stati verificati manualmente.

In particolare:

- temi poetici e modelli letterari sono stati estratti tramite script Python rule-based e successivamente controllati a campione;

- provenienza geografica e produzione editoriale sono state controllate manualmente;

- fasce d’età e case editrici sono state sottoposte a controlli a campione per verificare la coerenza del dataset.

Questo passaggio è stato fondamentale per correggere:

- varianti lessicali

- refusi

- ambiguità semantiche

- casi limite non interpretabili automaticamente

In altre parole:

l’AI non ha sostituito l’analisi.

Ha accelerato un metodo che è rimasto, fino all’ultimo passaggio, validato dall’essere umano.

Cosa è emerso

Dal primo dataset sono emersi, tra gli altri, questi dati:

- 45 poetesse censite

- 122 opere poetiche pubblicate

Tra i risultati più interessanti:

- Alda Merini (51%) è il modello poetico più citato

- Emily Dickinson (35%) è il secondo riferimento più ricorrente

- Quasi una poetessa su due ha pubblicato tra 2 e 3 opere

- Nessuna casa editrice supera il 10% delle opere censite

- Solo 7 poetesse su 45 hanno pubblicato più volte con lo stesso editore

Il vero insight

Il punto non è soltanto aver raccontato 45 poetesse. Il punto è aver dimostrato che:

un archivio editoriale, se progettato bene, può diventare anche uno strumento di osservazione culturale.

Ed è forse questo il confine più interessante del digital marketing oggi: quando il contenuto smette di essere solo contenute e inizia a produrre conoscenza.

Chiusura

Come filologa, giornalista e professionista del digital marketing, questo progetto rappresenta esattamente il punto in cui si incontrano: umanesimo, dati e strategia editoriale.

Ed è solo il primo dataset: ho raffinato le domande nel Modulo in modo da poter costruire nel tempo un archivio di dati sempre più strutturato.